Las publicaciones que piden la cancelación de ChatGPT están inundando Reddit y X después de que el CEO de OpenAI, Sam Altman, anunciara un acuerdo con el Departamento de Defensa de EE. UU. para implementar los modelos de inteligencia artificial de la compañía en redes militares clasificadas.

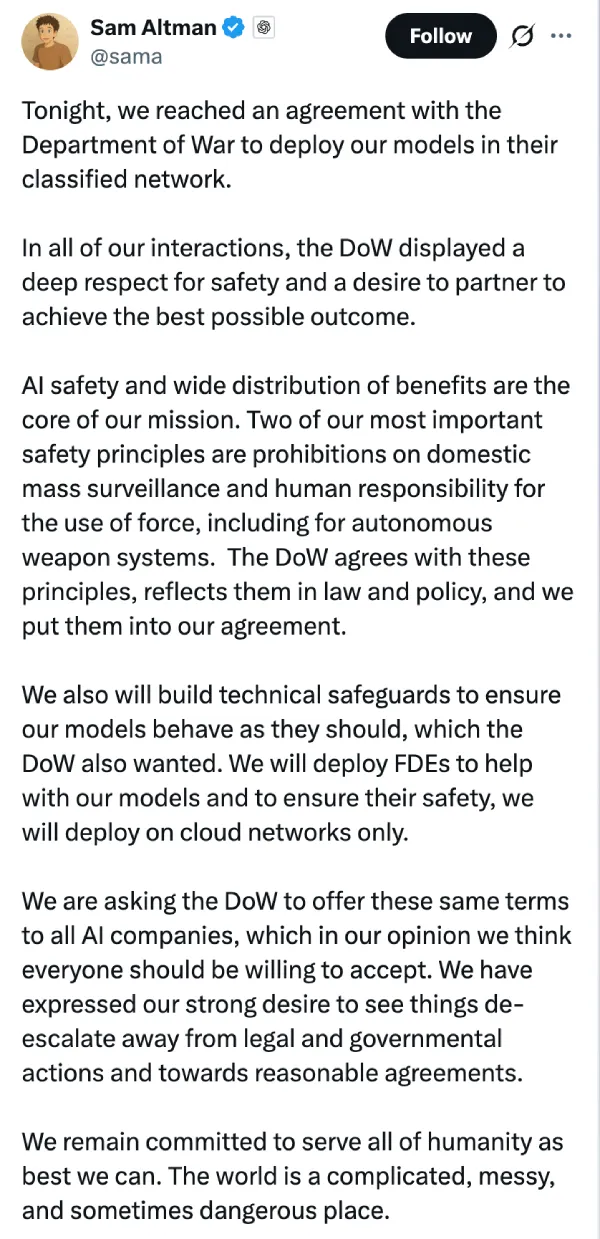

La noticia se dio a conocer tarde el viernes cuando Altman publicó en X que OpenAI había “alcanzado un acuerdo con el Departamento de Defensa para desplegar nuestros modelos en su red clasificada,” añadiendo que el DoD mostró “un profundo respeto por la seguridad” durante las negociaciones. Como era de esperar, muchos usuarios no lo tomaron en serio.

El momento hace que sea más difícil tomar esa declaración al pie de la letra. Más temprano ese mismo día, la administración de Trump prohibió a Anthropic participar en cualquier trabajo del gobierno de EE. UU., con el Secretario de Defensa, Pete Hegseth, llamando a la startup de IA un “riesgo para la cadena de suministro.” Anthropic se había negado a firmar un contrato con el Pentágono sin garantías de que sus modelos no se utilizarían para la vigilancia masiva de ciudadanos estadounidenses o para armas completamente autónomas. El gobierno los descartó. OpenAI firmó un acuerdo horas después.

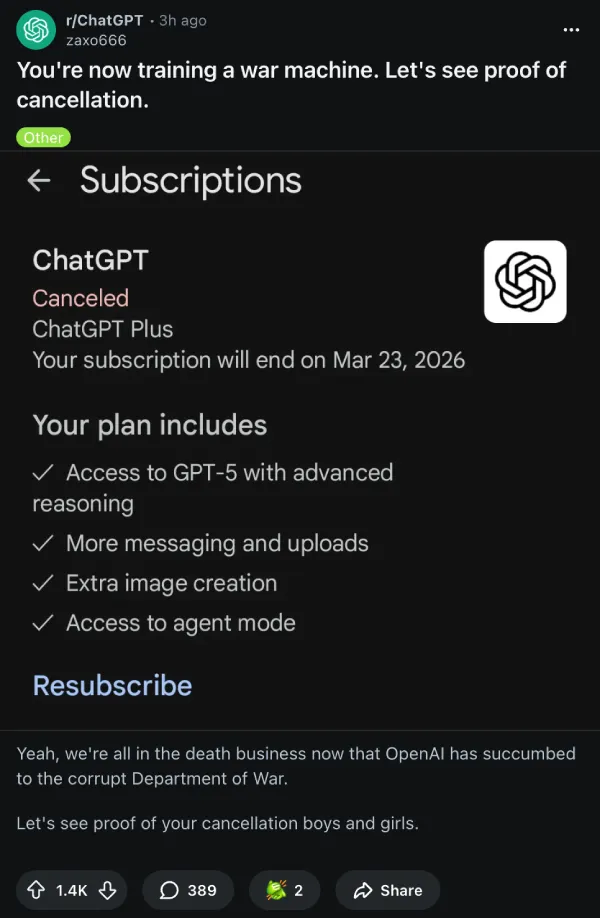

En Reddit, dos hilos están impulsando la mayor parte de la reacción negativa. Un hilo titulado “Ahora estás entrenando una máquina de guerra. Veamos pruebas de la cancelación,” está lleno de capturas de pantalla de cancelaciones, algunas de ellas señalando la ironía: Altman expresó públicamente su apoyo al CEO de Anthropic, Dario Amodei, esa misma mañana, y luego anunció el acuerdo con el DoD horas más tarde.

Otro hilo, “¡Cancela y elimina ChatGPT!!!”, ha superado los 1,700 votos positivos, con usuarios también impulsando reseñas negativas en la App Store y Play Store. Muchos dicen que están cambiando a Claude, con un usuario escribiendo: “Respeto a una empresa que se adhiere a sus principios. Anthropic ha ganado mi negocio.”

En X, las respuestas a la publicación de Altman son en su mayoría negativas. “Aquellos que no desean financiar a Skynet deberían cancelar sus cuentas de ChatGPT” es una de las reacciones más contundentes que circulan.

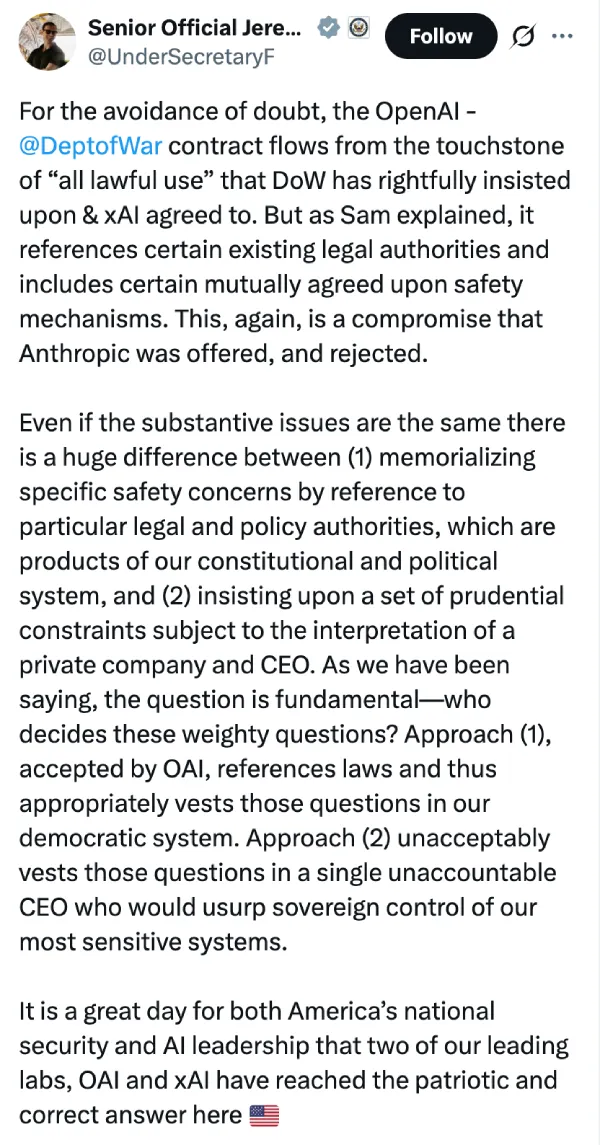

El lado del DoD también está rechazando con fuerza la idea de que esto es simplemente OpenAI interviniendo después de que Anthropic dijera que no. El funcionario senior Jeremy Lewin escribió en X que la diferencia es cómo se redactan los límites. Afirmó que el contrato de OpenAI ancla los límites a las autoridades legales y políticas existentes, no a los términos de servicio de una empresa.

En su opinión, permitir que una empresa privada defina los límites “normativos” para la IA militar otorga demasiado control a un CEO, y el gobierno no aceptará eso para sistemas sensibles. Lewin también dijo que este mismo compromiso fue ofrecido a Anthropic y rechazado.

No es la primera vez que OpenAI ha atraído este tipo de escrutinio. Informamos a principios de este mes que OpenAI eliminó silenciosamente la palabra “de manera segura” de su declaración de misión en una reciente presentación de Formulario 990 ante el IRS. Con este acuerdo con el DoD, ahora parece una confirmación de lo que ese cambio sugería.